気候変動

気候変動リスクが企業価値を左右する現在、エネルギー構造の転換を捉えることはESG投資の最重要課題である。2025年、太陽光の爆発的普及によりクリーン電力が新規需要をすべて吸収し、ついに再生可能エネルギーが石炭火力を逆転した。本記事では、英シンクタンクEmberの最新レポート「Global Electricity Review 2026」を基に、世界の電力市場が迎えた歴史的転換点を詳解する。*1

レポートのハイライト:化石燃料の停滞と太陽光の躍進

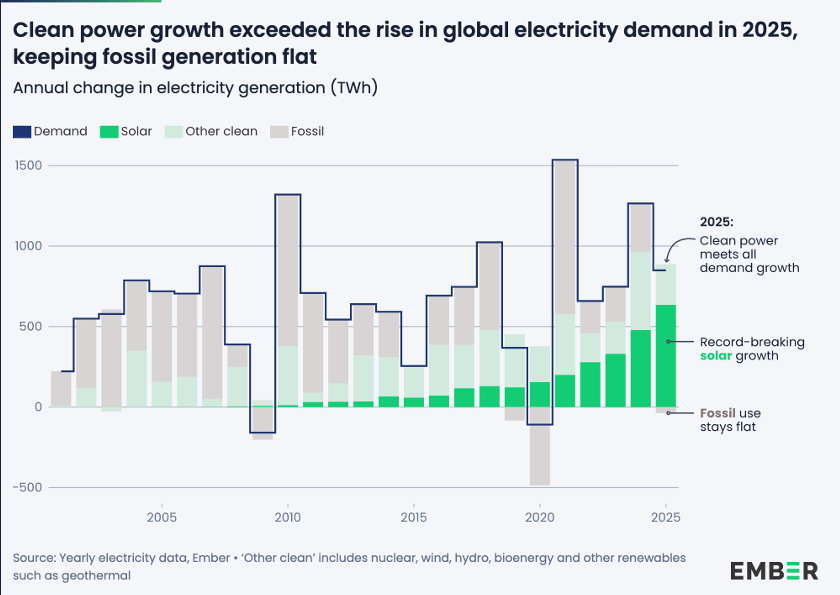

記録的な太陽光発電の成長により、クリーンな電力源が2025年のすべての新規電力需要を満たすのに十分な速さで拡大し、結果として化石燃料発電の増加を完全に食い止めた。化石燃料による発電量が増加しなかったのは2020年以来であり、今世紀に入ってからはわずか5回目の出来事である。これまで世界の化石燃料発電増加を歴史的に牽引してきた中国とインドの両国においても、2025年は化石燃料発電の減少を記録した。両国では記録的なクリーン電力の導入が需要増加を上回り、これが世界の化石燃料発電の純成長を停止させる原動力となった。

太陽光発電は、世界の電力セクターに変化をもたらす最大の推進力としての地位を確固たるものにし、その記録的な成長は2025年の電力需要の純増分の実に4分の3を賄った。この太陽光の増加量は、2025年に唯一増加した化石燃料であるガスの18倍に達する規模である。現在、世界の太陽光発電量はEU全体の総電力需要に匹敵する規模にまで成長している。

中国は再び太陽光発電の建設を牽引し、2025年における世界の太陽光発電容量および発電量増加分の過半数を占めた。これにより、中国の発電ミックスにおける太陽光と風力のシェアは22%へと跳ね上がり、OECD平均(20%)を凌駕した。インドもまたクリーン電力の導入を急加速させている。再生可能エネルギーの成長は過去の記録を倍に更新し、初めて米国を上回る新規太陽光発電容量を導入した。

図【2025年には、クリーン電力の成長が世界の電力需要の増加を上回り、化石燃料発電を横ばいに維持した】

出典:Ember、Global Electricity Review 2026

もう一つの世界的なマイルストーンとして、2025年に再生可能エネルギーが石炭火力を逆転した。太陽光、風力、水力などを含む再生可能エネルギーの合計が世界の発電量に占める割合は、近代の電力システムにおいて初めて3分の1を突破した。対照的に、石炭火力のシェアは歴史上初めて3分の1を割り込んでいる。

太陽光発電の導入加速はバッテリー蓄電の普及と並行して進んでおり、「日中の太陽光」から「いつでも使える太陽光」への次なるパラダイムシフトを実現しつつある。バッテリーコストは2024年に20%下落したことに続き、2025年にはさらに45%下落するなど、2年連続で急激に低下した。その結果、導入量は46%増の推定250 GWhに達し、世界全体で2025年の新規太陽光発電量の14%を日中から他の時間帯へシフトさせるのに十分なバッテリー容量が設置された。

チリやオーストラリアに代表される先駆的な国々は、2025年の新規太陽光発電の50%以上をシフト可能なグリッドレベルの蓄電システムをすでに配備しており、電力価格の低下や出力抑制の削減といった恩恵をすでに享受し始めている。

重要なポイント

ここから先は「ThinkESG プレミアム」会員限定の

コンテンツです。

4つの特典が受けられる「ThinkESG プレミアム会員(1ヶ月定期購読)」の詳細についてはこちらをご覧ください。

「ThinkESG プレミアム会員(1ヶ月定期購読)」へはこちらからお申し込みいただけます。